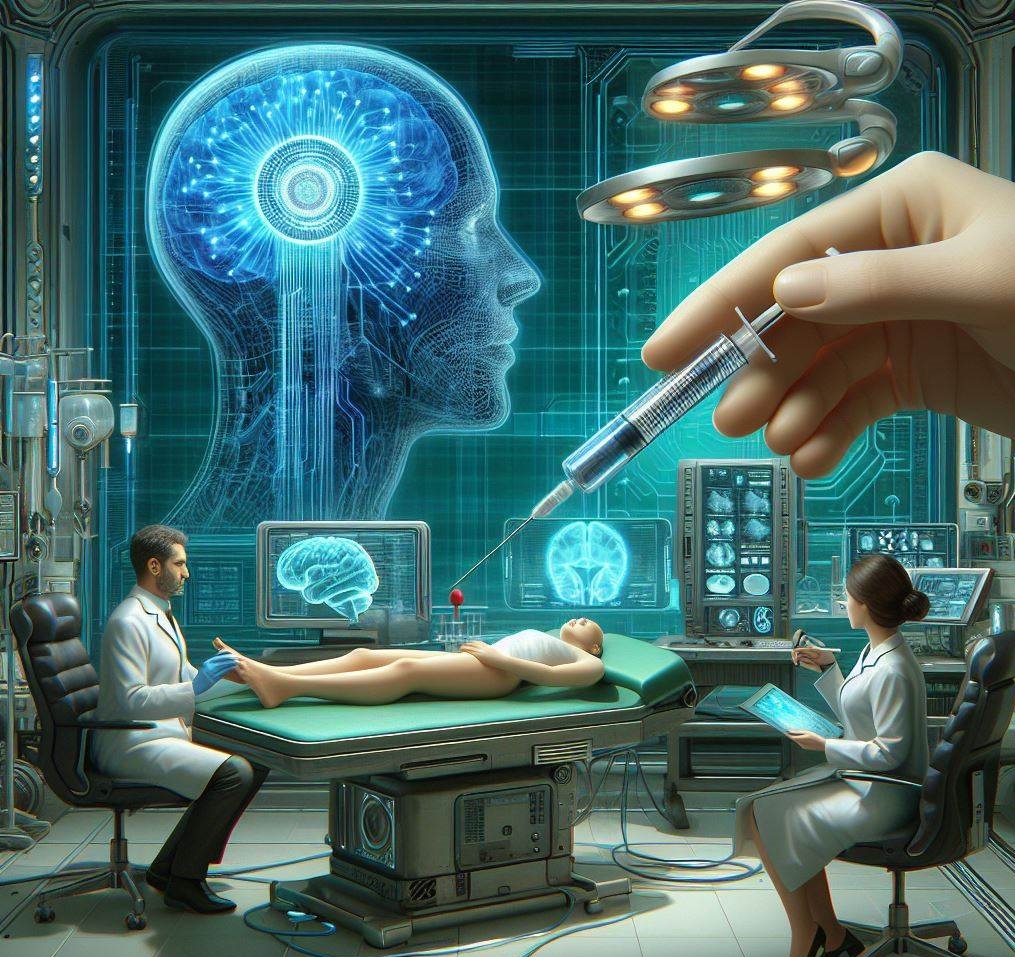

近年、自然言語処理技術の一つである「ChatGPT」の利用が急速に広まっています。ChatGPTは、自然言語処理によって文章を自動生成することができるため、多くの企業や研究機関で利用されています。しかし、この技術の利用によって、個人情報保護に関する問題が浮き彫りになってきています。本稿では、「ChatGPTの利用における個人情報保護方針の見直しを求める声が高まる中での現状と課題」について考えてみましょう。

まず、ChatGPTの利用において問題視されている点は、自動生成された文章に含まれる個人情報の取り扱いです。ChatGPTが自動生成した文章には、個人情報が含まれることがあります。例えば、名前や住所、電話番号などが含まれる場合があります。このような情報が自動生成された文章で不適切な形で扱われると、プライバシーの侵害や個人情報漏洩のリスクが生じる可能性があります。

このような問題を解決するためには、ChatGPTの利用における個人情報保護方針の見直しが必要です。企業や研究機関は、ChatGPTが自動生成する文章に含まれる個人情報を適切に扱うために、個人情報保護に関する規定を導入する必要があります。例えば、個人情報を自動生成しないようにプログラムを改良する、個人情報が含まれる文章の自動削除などの対策が考えられます。

一方で、ChatGPTの利用における個人情報保護方針の見直しには、いくつかの課題が存在します。まず、ChatGPTが自動生成する文章には、個人情報以外にも、社会的・文化的な背景や嗜好などの情報が含まれることがあります。そのため、個人情報保護と同時に、情報の正確性や偏りを修正する必要があります。

さらに、ChatGPTの利用においては、個人情報以外にも、機密性の高い情報を扱うことがあります。例えば、企業がChatGPTを利用して内部文書を自動生成する場合、機密性の高い情報が含まれる可能性があります。そのため、個人情報保護だけでなく、情報セキュリティについても注意が必要です。企業や研究機関は、情報セキュリティに関する規定を策定し、適切な管理を行うことが求められます。

また、ChatGPTの利用における個人情報保護方針の見直しには、技術的な問題もあります。自然言語処理技術は、高度に複雑なアルゴリズムによって動作しています。そのため、個人情報を自動生成することを完全に防止することは困難であり、技術的な課題を克服する必要があります。

最後に、ChatGPTの利用における個人情報保護方針の見直しには、個人情報保護法や規制に関する法律に基づいた取り組みも必要です。各国が制定する個人情報保護法や規制に準拠し、適切な個人情報保護方針を策定することが求められます。

以上のように、ChatGPTの利用における個人情報保護方針の見直しには、技術的な課題や法的な規制に関する問題が存在します。しかし、個人情報保護を重視することで、プライバシーの侵害や個人情報漏洩のリスクを低減することができます。企業や研究機関は、個人情報保護に関する規定を遵守し、ChatGPTの利用における個人情報保護方針の見直しに取り組むことが求められます。

「昼はすき家でカレー!スマホ代は月1000円!」.jpg)

とみられる男の身柄確保-818x1024.jpg)