AI技術の進歩は、自然言語処理技術の一つである「GPT-3」というモデルが開発され、その高い自然言語生成能力から多くの注目を集めています。しかし、その進歩が一部の国で禁止されていることが問題視されています。本稿では、AIの進歩がもたらす「chatGPT禁止の国」のリスクについて考えてみましょう。

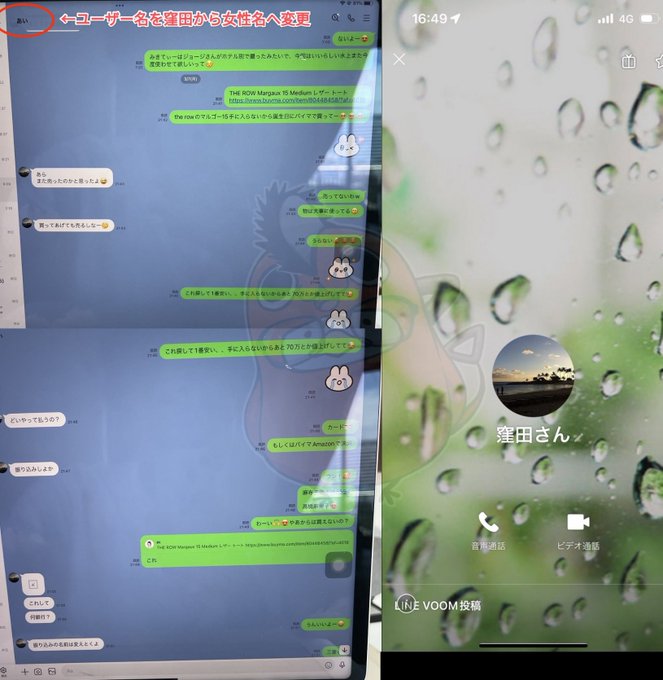

まず、AIの進歩によって、「chatGPT禁止の国」が生まれることは、AI技術の普及とともに、ますますリスクとなっています。特に、自動生成された情報が政治的・宗教的な信条に反する発言や、違法行為などを含む場合、国家や社会に大きな悪影響を及ぼす可能性があるため、一部の国がその技術の利用を禁止していると考えられます。

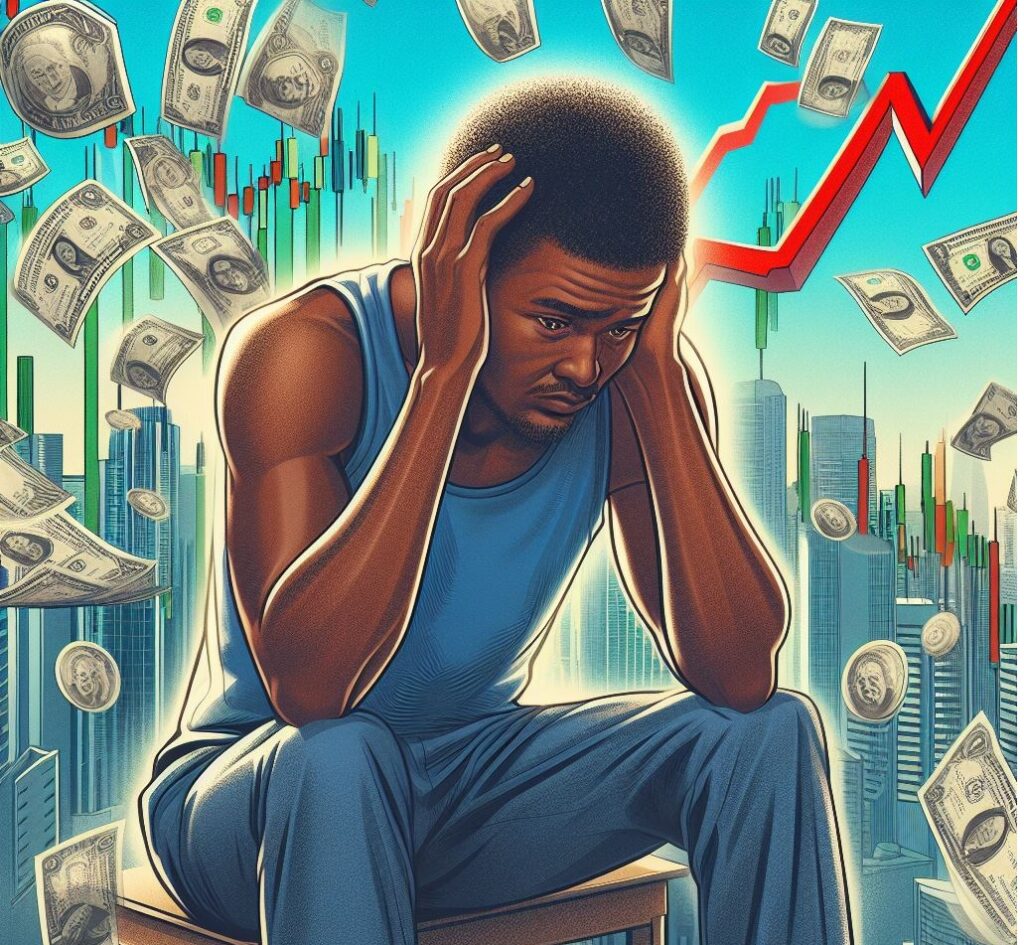

また、AI技術を活用することによって得られる経済的な利益や、新たなビジネスの創出などのメリットが生じる可能性があります。しかし、「chatGPT禁止の国」においては、そのようなサービスや製品を提供することができなくなるため、経済的な損失や技術的な遅れを招く可能性があります。

さらに、AI技術の進歩がもたらす「chatGPT禁止の国」のリスクとして、技術的な制限があることから、人工知能技術を活用した新しい発想やアイデアが生まれにくくなることも懸念されています。これにより、国家や企業が直面する問題に対する解決策が見つかりにくくなり、技術的な遅れを招く可能性があります。

一方で、AI技術の進歩によって「chatGPT禁止の国」を避けることも可能です。例えば、AI技術を活用する際には、倫理的・社会的な問題や国家安全保障上の懸念を考慮した技術開発が必要です。また、情報の監視やデータの保護などの規制を導入することで、人々のプライバシーや個人情報保護に対する配慮も必要です。

以上のように、AI技術の進歩がもたらす「chatGPT禁止の国」のリスクは多岐にわたっていますが、そのリスクを避けるためには、適切な規制や監視が必要とされています。AI技術を活用しつつ、倫理的・社会的な問題や国家安全保障上の懸念に対処し、技術的な進歩を遅らせることなく、持続的な発展を目指すことが大切です。

また、AI技術の進歩がもたらす「chatGPT禁止の国」のリスクは、単一の技術だけでなく、AI技術全般にわたって存在する可能性があります。そのため、AI技術を利用する国や企業は、倫理的・社会的な問題や国家安全保障上の懸念に対処するための規制や監視体制を強化する必要があります。

最後に、AI技術の進歩がもたらす「chatGPT禁止の国」のリスクを避けるためには、国際的な協力が必要です。AI技術を利用する国や企業は、AI技術の利用に関する国際的な規格やガイドラインを共有することで、倫理的・社会的な問題や国家安全保障上の懸念に対処することができます。国際的な協力によって、AI技術を活用しつつ、持続的な発展を目指すことができます。

、ビキニ姿でふんわりバスト披露!くっきり美谷間に釘付け「美ボディ過ぎ」-768x1024.jpg)

のチアガールさん美人すぎる!!.jpg)